|

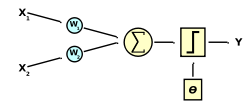

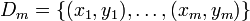

| Perceptrón con 2 entradas |

Definición El modelo biológico más simple de un perceptrón es una neurona y vice versa. Es decir, el modelo matemático más simple de una neurona es un perceptrón. La neurona es una célula especializada y caracterizada por poseer una cantidad indefinida de canales de entrada llamados dendritas y un canal de salida llamado axón. Las dendritas operan como sensores que recogen información de la región donde se hallan y la derivan hacia el cuerpo de la neurona que reacciona mediante una sinapsis que envía una respuesta hacia el cerebro, esto en el caso de los seres vivos.

Una neurona sola y aislada carece de razón de ser. Su labor especializada se torna valiosa en la medida en que se asocia a otras neuronas, formando una red. Normalmente, el axón de una neurona entrega su información como "señal de entrada" a una dendrita de otra neurona y así sucesivamente. El perceptrón que capta la señal en adelante se entiende formando una red de neuronas, sean éstas biológicas o de sustrato semiconductor (compuertas lógicas).

El perceptrón usa una matriz para representar las redes neuronales y es un discriminador terciario que traza su entrada

(un vector binario) a un único valor de salida

(un vector binario) a un único valor de salida  (un solo valor binario) a través de dicha matriz.

(un solo valor binario) a través de dicha matriz.

Donde

es un vector de pesos reales y

es un vector de pesos reales y  es el producto punto (que computa una suma ponderada).

es el producto punto (que computa una suma ponderada).  es el 'umbral', el cual representa el grado de inhibición de la

neurona, es un término constante que no depende del valor que tome la

entrada.

es el 'umbral', el cual representa el grado de inhibición de la

neurona, es un término constante que no depende del valor que tome la

entrada.El valor de

(0 o 1) se usa para clasificar

(0 o 1) se usa para clasificar  como un caso positivo o un caso negativo, en el caso de un problema de

clasificación binario. El umbral puede pensarse de como compensar la

función de activación, o dando un nivel bajo de actividad a la neurona

del rendimiento. La suma ponderada de las entradas debe producir un

valor mayor que

como un caso positivo o un caso negativo, en el caso de un problema de

clasificación binario. El umbral puede pensarse de como compensar la

función de activación, o dando un nivel bajo de actividad a la neurona

del rendimiento. La suma ponderada de las entradas debe producir un

valor mayor que  para cambiar la neurona de estado 0 a 1.

para cambiar la neurona de estado 0 a 1.Aprendizaje

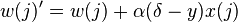

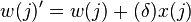

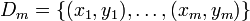

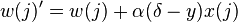

En el perceptrón, existen dos tipos de aprendizaje, el primero utiliza una tasa de aprendizaje mientras que el segundo no la utiliza. Esta tasa de aprendizaje amortigua el cambio de los valores de los pesos.1El algoritmo de aprendizaje es el mismo para todas las neuronas, todo lo que sigue se aplica a una sola neurona en el aislamiento. Se definen algunas variables primero:

- el

denota el elemento en la posición

denota el elemento en la posición  en el vector de la entrada

en el vector de la entrada - el

el elemento en la posición

el elemento en la posición  en el vector de peso

en el vector de peso - el

denota la salida de la neurona

denota la salida de la neurona - el

denota la salida esperada

denota la salida esperada - el

es una constante tal que

es una constante tal que

difiere de la salida deseada

difiere de la salida deseada  . Para considerar una neurona al interactuar en múltiples iteraciones debemos definir algunas variables más:

. Para considerar una neurona al interactuar en múltiples iteraciones debemos definir algunas variables más: denota el vector de entrada para la iteración i

denota el vector de entrada para la iteración i denota el vector de peso para la iteración i

denota el vector de peso para la iteración i denota la salida para la iteración i

denota la salida para la iteración i denota un periodo de aprendizaje de

denota un periodo de aprendizaje de  iteraciones

iteraciones

- Para cada pareja ordenada

en

en

- Pasar

a la regla de actualización

a la regla de actualización

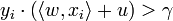

se dice que es separable linealmente si existe un valor positivo

se dice que es separable linealmente si existe un valor positivo  y un vector de peso

y un vector de peso  tal que:

tal que:  para todos los

para todos los  .

.Novikoff (1962) probo que el algoritmo de aprendizaje converge después de un número finito de iteraciones si los datos son separables linealmente y el número de errores está limitado a:

.

.Sin embargo si los datos no son separables linealmente, la línea de algoritmo anterior no se garantiza que converja.

Ejemplo

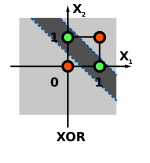

Considere las funciones AND y OR, estas funciones son linealmente separables y por lo tanto pueden ser aprendidas por un perceptrón.

La función XOR no puede ser aprendida por un único perceptrón puesto que requiere al menos de dos líneas para separar las clases (0 y 1). Debe utilizarse al menos una capa adicional de perceptrones para permitir su aprendizaje.